Samsung erweitert In-Memory-Rechenleistung

Samsung Electronics hat die diesjährige Hot Chips-Konferenz genutzt, um seine neuesten Fortschritte im Bereich Processing-in-Memory (PIM) vorzustellen. Technologie.

Samsung demonstrierte die erste erfolgreiche Integration seines PIM-fähigen High Bandwidth Memory (HBM-PIM) in ein kommerzialisiertes Beschleunigersystem und hat PIM-Anwendungen auf DRAM-Module und mobilen Speicher ausgeweitet, was die Konvergenz von Speicher und Logik beschleunigt.

HBM-PIM enthält die KI-Verarbeitungsfunktion zur Verbesserung der Hochgeschwindigkeits-Datenverarbeitung in Supercomputern und KI-Anwendungen und wurde im Xilinx Virtex Ultrascale+ (Alveo) KI-Beschleuniger getestet, wo es eine fast 2.5-fache Systemleistungssteigerung sowie mehr lieferte als 60 % weniger Energieverbrauch.

„HBM-PIM ist die erste KI-maßgeschneiderte Speicherlösung der Branche, die in KI-Beschleunigersystemen von Kunden getestet wird und ein enormes kommerzielles Potenzial zeigt“, sagte Nam Sung Kim, Senior Vice President DRAM Product & Technology bei Samsung Electronics. „Durch die Standardisierung der Technologie werden die Anwendungen zahlreich und werden sich auf HBM3 für Supercomputer der nächsten Generation und KI-Anwendungen und sogar auf mobilen Speicher für geräteinterne KI sowie für Speichermodule, die in Rechenzentren verwendet werden, ausweiten.“

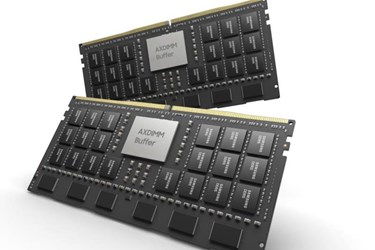

Das Acceleration DIMM (AXDIMM) bringt die Verarbeitung zum DRAM Modulen selbst, wodurch große Datenbewegungen zwischen CPU und DRAM minimiert werden, um die Energieeffizienz von KI-Beschleunigersystemen zu steigern.

Mit einer im Pufferchip integrierten KI-Engine kann das AXDIMM eine parallele Verarbeitung mehrerer Speicherränge (Sätze von DRAM-Chips) durchführen, anstatt nur jeweils auf einen Rank zuzugreifen, was die Systemleistung und -effizienz erheblich verbessert.

Da das Modul seinen traditionellen DIMM-Formfaktor beibehalten kann, erleichtert das AXDIMM den Drop-in-Ersatz, ohne dass Systemmodifikationen erforderlich sind.

Das AXDIMM wird derzeit auf Kundenservern getestet und bietet ungefähr die doppelte Leistung bei KI-basierten Empfehlungsanwendungen und eine 40%ige Senkung des systemweiten Energieverbrauchs.

Die mobile Speichertechnologie LPDDR5-PIM von Samsung kann unabhängige KI-Funktionen ohne Rechenzentrumskonnektivität bereitstellen. Simulationstests haben gezeigt, dass das LPDDR5-PIM die Leistung mehr als verdoppeln und gleichzeitig den Energieverbrauch um über 60 % senken kann, wenn es in Anwendungen wie Spracherkennung, Übersetzung und Chatbot verwendet wird.

Samsung plant, sein KI-Speicherportfolio durch die Zusammenarbeit mit anderen Branchenführern zu erweitern, um die Standardisierung der PIM-Plattform im ersten Halbjahr 2022 abzuschließen.