Samsung estende la potenza di elaborazione in memoria

Samsung Electronics ha utilizzato la conferenza Hot Chips di quest'anno per mostrare i suoi ultimi progressi con l'elaborazione in memoria (PIM) la tecnologia.

Samsung ha dimostrato la prima integrazione di successo della sua High Bandwidth Memory (HBM-PIM) abilitata per PIM in un sistema di accelerazione commercializzato e ha ampliato le applicazioni PIM per abbracciare i moduli DRAM e la memoria mobile che accelera il passaggio verso la convergenza di memoria e logica.

HBM-PIM incorpora la funzione di elaborazione AI per migliorare l'elaborazione dei dati ad alta velocità nei supercomputer e nelle applicazioni AI ed è stato testato nell'acceleratore AI Xilinx Virtex Ultrascale+ (Alveo), dove ha fornito un aumento delle prestazioni del sistema di quasi 2.5 volte e più oltre il 60% di riduzione dei consumi energetici.

"HBM-PIM è la prima soluzione di memoria su misura per l'intelligenza artificiale del settore testata nei sistemi di accelerazione dell'intelligenza artificiale dei clienti, dimostrando un enorme potenziale commerciale", ha affermato Nam Sung Kim, vicepresidente senior di DRAM Product & Technology presso Samsung Electronics. “Attraverso la standardizzazione della tecnologia, le applicazioni diventeranno numerose, espandendosi in HBM3 per supercomputer di nuova generazione e applicazioni AI, e persino nella memoria mobile per AI on-device, nonché per i moduli di memoria utilizzati nei data center”.

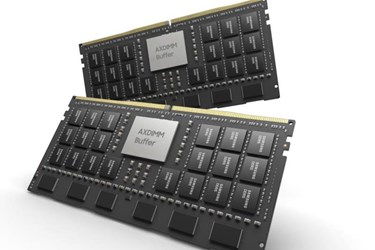

Il DIMM di accelerazione (AXDIMM) porta l'elaborazione nella DRAM modulo stesso, riducendo al minimo lo spostamento di dati di grandi dimensioni tra CPU e DRAM per aumentare l'efficienza energetica dei sistemi di accelerazione AI.

Con un motore AI integrato nel chip buffer, AXDIMM può eseguire l'elaborazione parallela di più rank di memoria (set di chip DRAM) invece di accedere a un solo rank alla volta, migliorando notevolmente le prestazioni e l'efficienza del sistema.

Poiché il modulo può mantenere il suo tradizionale fattore di forma DIMM, AXDIMM facilita la sostituzione rapida senza richiedere modifiche al sistema.

Attualmente in fase di test sui server dei clienti, AXDIMM può offrire circa il doppio delle prestazioni nelle applicazioni di raccomandazione basate sull'intelligenza artificiale e una riduzione del 40% nell'utilizzo di energia a livello di sistema.

La tecnologia di memoria mobile LPDDR5-PIM di Samsung può fornire funzionalità AI indipendenti senza connettività del data center. I test di simulazione hanno dimostrato che LPDDR5-PIM può più che raddoppiare le prestazioni riducendo il consumo energetico di oltre il 60% se utilizzato in applicazioni come il riconoscimento vocale, la traduzione e il chatbot.

Samsung prevede di espandere il proprio portafoglio di memorie AI collaborando con altri leader del settore per completare la standardizzazione della piattaforma PIM nella prima metà del 2022.