Eine "einzigartige" Vision

Anfang dieses Monats Nvidias GPU Technologie Auf der Konferenz wurden neue Produkte, Plattformen und Kundenneuigkeiten vorgestellt.

Nvidia hat möglicherweise umfangreiche und detaillierte Kritik an der geplanten Übernahme von Arm geäußert, aber abgesehen davon bleibt es ein führendes Technologieunternehmen, das stark in CPUs, DPUs und GPUs investiert, um eine Vielzahl neuer Technologien von autonomen Maschinen anzusprechen zu virtuellen Welten und künstlicher Intelligenz.

Auf der diesjährigen GPU-Technologiekonferenz erweiterte sein CEO Jensen Huang die Vision des Unternehmens und sprach davon, dass es sich um eine „Computerplattform“ handelt, die dazu beiträgt, die Arbeit für die Da Vincis unserer Zeit voranzutreiben - im Bereich Sprachverständnis, Wirkstoffforschung oder Quantencomputer . ”

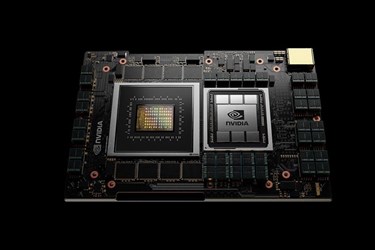

Huang sprach ausführlich darüber, wie stark Nvidia in CPUs, DPUs und GPUs investiert und daran arbeitet, diese in neue Rechenlösungen für Rechenzentren für Forscher und Unternehmen zu verweben.

Huang nutzte seine Keynote, um Nvidias erste Rechenzentrums-CPU, Grace, anzukündigen, benannt nach Grace Hopper, einer Konteradmiralin der US Navy und Pionierin der Computerprogrammierung.

Grace ist ein hochspezialisierter Prozessor, der speziell für datenintensive HPC- und AI-Anwendungen entwickelt wurde, die Verarbeitungsmodelle der nächsten Generation in natürlicher Sprache mit mehr als einer Billion Parametern trainieren.

In Verbindung mit Nvidia-GPUs kann ein Grace-basiertes System eine 10-mal schnellere Leistung liefern als die heutigen hochmodernen Nvidia DGX-basierten Systeme, die laut Angaben des Unternehmens auf x86-CPUs ausgeführt werden.

"Hochmoderne KI und Datenwissenschaft bringen die heutige Computerarchitektur an ihre Grenzen", sagte Huang. "Durch die Verwendung von Arm IP wurde Grace speziell für KI und HPC im Riesenmaßstab entwickelt. Nvidia kann jetzt als Drei-Chip-Unternehmen bezeichnet werden. “

Während die überwiegende Mehrheit der Rechenzentren voraussichtlich von vorhandenen CPUs bedient wird, soll Grace ein Nischensegment des Computing bedienen.

Huang gab bekannt, dass das Schweizerische Nationale Supercomputing-Zentrum (CSCS) einen Supercomputer namens Alpen bauen wird, der von den GPUs der nächsten Generation von Grace und Nvidia angetrieben wird.

Alps wird von Hewlett Packard Enterprise unter Verwendung der neuen HPE Cray EX-Supercomputer-Produktlinie sowie der Nvidia HGX-Supercomputerplattform gebaut und umfasst Nvidia-GPUs sowie die Grace-CPU.

CSCS-Benutzer können in den Alpen eine breite Palette neuer wissenschaftlicher Forschungen durchführen, von der Analyse wissenschaftlicher Arbeiten bis zur Erzeugung neuer Moleküle für die Wirkstoffforschung.

Das Los Alamos National Laboratory des US-Energieministeriums wird 2023 auch einen Supercomputer mit Grace-Antrieb online stellen, gab Nvidia bekannt.

Bluefield-3-DPU

Huang beschleunigte die Infrastruktur, auf der Hyperscale-Rechenzentren, Workstations und Supercomputer aufgebaut sind, und stellte die neue BlueField-3-DPU vor.

Huang: „Mit dieser DPU kann jedes Unternehmen Anwendungen in jeder Größenordnung mit branchenführender Leistung und Sicherheit für Rechenzentren bereitstellen. Es wurde für mandantenfähige, Cloud-native Umgebungen optimiert und bietet softwaredefinierte, hardwarebeschleunigte Netzwerk-, Speicher- und Verwaltungsdienste im Rechenzentrumsmaßstab. “

Wenn BlueField-2 das Äquivalent von 30 CPU-Kernen auslagerte, wären bei Bluefield-3 300 CPU-Kerne erforderlich, um den Netzwerkverkehr mit 400 Gbit / s zu sichern, auszulagern und zu beschleunigen, da dies einen 10-fachen Leistungssprung bietet, erklärte Huang.

Sowohl Grace als auch BlueField bilden wesentliche Bestandteile einer Roadmap für Rechenzentren, die jetzt aus CPUs, GPUs und DPUs besteht, fügte Huang hinzu.

„Jede Chip-Architektur hat einen Zweijahresrhythmus mit wahrscheinlich einem Kicker dazwischen. Ein Jahr wird sich auf x86-Plattformen konzentrieren, das nächste auf Arm-Plattformen “, sagte Huang und fügte hinzu:„ Jedes Jahr werden Sie neue aufregende Produkte von uns sehen. “

Arm in die Cloud erweitern

Vor der Nachricht, dass die britische Regierung die britische Wettbewerbsbehörde, die CMA, beauftragt habe, die geplante Übernahme von Arm zu untersuchen, sprach Huang ausführlich über Arm und sagte, dass es aus "guten Gründen" die beliebteste CPU der Welt geworden sei. Dies deutet darauf hin, dass es nicht nur „super energieeffizient“ war, sondern dass sein „offenes Lizenzmodell eine Welt der Innovatoren inspirierte“.

Ob dieses Modell bestehen bleibt, sollte die Akquisition fortgesetzt werden, bleibt ein strittiger Punkt, aber Huang nutzte seine Keynote, um neue Arm-Partnerschaften anzukündigen, die Amazon Web Services im Bereich Cloud Computing, Ampere Computing im Bereich Wissenschaft und Cloud Computing, Marvel bei hyperkonvergenten Edgeservern und MediaTek erstellt ein Chrome OS- und Linux PC SDK und ein Referenzsystem.

„Das globale Ökosystem von Technologieunternehmen von Arm wird Arm-basierte Produkte in neue Märkte wie Cloud-, Supercomputing-, PC- und autonome Systeme bringen. Mit den angekündigten neuen Partnerschaften unternehmen wir wichtige Schritte, um das Arm-Ökosystem über mobile und eingebettete hinaus auszubauen “, sagte Huang.

Nvidia und AWS arbeiten zusammen, um GPU-beschleunigte Arm-basierte Instanzen in der Cloud bereitzustellen. Die neuen Amazon EC2-Instanzen werden AWS Graviton2-Prozessoren und Nvidia-GPUs zusammenführen, um eine Reihe von Vorteilen zu bieten, darunter niedrigere Kosten, Unterstützung für umfassendere Game-Streaming-Erlebnisse und höhere Leistung für armbasierte Workloads.

Mithilfe dieser Instanzen können Spieleentwickler Android-Spiele nativ auf AWS ausführen, das Rendern und Codieren mit Nvida-GPUs beschleunigen und Spiele auf mobile Geräte streamen, ohne dass Emulationssoftware ausgeführt werden muss.

Das Arm HPC Developer Kit von Nvidia wurde entwickelt, um das wissenschaftliche Rechnen angesichts des wachsenden Bedarfs an energieeffizienten Supercomputern und Rechenzentren zu unterstützen.

Das Kit enthält eine Ampere Altra-CPU mit 80 Arm Neoverse-Kernen mit bis zu 3.3 GHz. Zwei Nvidia A100-GPUs mit jeweils 312 Teraflops FP16-Deep-Learning-Leistung sowie zwei BlueField-2-DPUs, die die Vernetzung, Speicherung und Sicherheit beschleunigen sollen.

Entwickler und ISV-Partner können das Devkit verwenden, um ihre Software zu migrieren und zu validieren und Leistungsanalysen durchzuführen.

Zu den Rechenzentren, in denen es eingesetzt wird, gehören das Oak Ridge National Laboratory, das Los Alamos National Laboratory und die Stony Brook University in den USA. das Nationale Zentrum für Hochleistungsrechnen in Taiwan; und das Koreanische Institut für Wissenschaft und Technologie.

Nvidias Omniversum

Huang enthüllte auch das Nvidia Omniverse. Als Cloud-native, auf mehrere GPUs skalierbare, physikalisch genaue Plattform kann sie virtuelle 3D-Welten neu erstellen, die RTX-Echtzeit-Pfadverfolgung und DLSS nutzen, Materialien mit Nvidia MDL simulieren, Physik mit Nvidia PhysX simulieren und Nvidia vollständig integrieren AI.

Laut Huang wurde „Omniverse geschaffen, um gemeinsame virtuelle 3D-Welten zu schaffen. Eine, die der von Neal Stephenson in seinem Roman 'Snow Crash' aus den frühen 1990er Jahren beschriebenen Science-Fiction-Metaverse nicht unähnlich ist. “

Omniverse wird für Unternehmenslizenzen verfügbar sein und arbeitet derzeit mit offenen Beta-Partnern wie Foster and Partners in Architecture, ILM in Entertainment, Activision in Gaming und dem Werbegiganten WPP zusammen.

Die Demonstration der Möglichkeiten des Omniversums Huang zusammen mit Milan Nedeljković, Mitglied der Geschäftsführung von BMW, zeigte, wie ein fotorealistisches digitales Echtzeitmodell - ein „digitaler Zwilling“ einer der hochautomatisierten Fabriken von BMW - sein kann verwendet, um die moderne Fertigung zu beschleunigen.

„Diese neuen Innovationen werden die Planungszeiten verkürzen, die Flexibilität und Präzision verbessern und eine um 30 Prozent effizientere Planung ermöglichen“, sagte Nedeljković.

Weitere Ankündigungen waren die Enthüllung des Megatron, eines Frameworks für das Training von Transformatoren, das zu Durchbrüchen bei der Verarbeitung in natürlicher Sprache führte - Transformatoren generieren Dokumentzusammenfassungen, vollständige Phrasen in E-Mails, Notenquiz, Generieren von Live-Sportkommentaren, sogar Code - sowie neue Modelle für Clara Discovery, Nvidias Beschleunigungsbibliotheken für die rechnergestützte Wirkstoffentdeckung.

Eine weitere Ankündigung betraf Nvidia Morpheus - eine Rechenzentrums-Sicherheitsplattform für die Echtzeit-All-Packet-Inspektion, die auf Nvidia AI, BlueField, Net-Q-Netzwerktelemetriesoftware und EGX basiert.

Um die Konversations-KI zu beschleunigen, kündigte Huang auch die Verfügbarkeit von Nvidia Jarvis an - einer hochmodernen Deep-Learning-KI für Spracherkennung, Sprachverständnis, Übersetzungen und Ausdruckssprache.

Heute bietet Nvidia GPUs, CPUs und DPUs an und investiert weiterhin stark in AI und in das Omniversum des Unternehmens

Zum Abschluss seiner Keynote sagte Huang vor dem Online-Publikum, Nvidia sei „das Instrument für Ihr Lebenswerk“, und in Umfang und Breite der Ankündigungen wurde das Ausmaß der Ambitionen des Unternehmens und seine „einzigartigen Ambitionen“ deutlich.