Uma visão 'singular'

No início deste mês, GPU da Nvidia Equipar A conferência contou com a revelação de novos produtos, plataformas e novidades para clientes.

A Nvidia pode ter recebido críticas extensas e detalhadas por sua proposta de aquisição da Arm, mas, deixando isso de lado, ela continua sendo uma empresa líder em tecnologia que está investindo pesadamente em CPUs, DPUs e GPUs, já que busca abordar uma miríade de novas tecnologias de máquinas autônomas para mundos virtuais e inteligência artificial.

Na GPU Technology Conference deste ano, seu CEO Jensen Huang expandiu a visão da empresa e falou sobre ela como sendo uma “plataforma de computação, ajudando a avançar o trabalho para o Da Vincis de nosso tempo - em compreensão de linguagem, descoberta de medicamentos ou computação quântica . ”

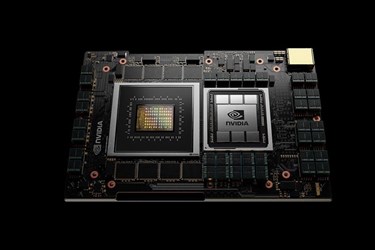

Huang falou longamente sobre como a Nvidia está investindo pesadamente em CPUs, DPUs e GPUs e está trabalhando para integrá-los em novas soluções de computação em escala de data center para pesquisadores e empresas.

Huang usou sua palestra para anunciar a primeira CPU de data center da Nvidia, Grace, em homenagem a Grace Hopper, contra-almirante da Marinha dos Estados Unidos e pioneira na programação de computadores.

Grace é um processador altamente especializado que foi projetado para atingir grandes aplicativos de HPC e AI com uso intensivo de dados, treinando modelos de processamento de linguagem natural de próxima geração que têm mais de um trilhão de parâmetros.

Quando acoplado com GPUs Nvidia, um sistema baseado em Grace será capaz de fornecer desempenho 10x mais rápido do que os atuais sistemas Nvidia DGX de última geração, que rodam em CPUs x86, de acordo com a empresa.

“A IA de ponta e a ciência de dados estão levando a arquitetura de computador de hoje além de seus limites”, disse Huang, “mas usando o Arm IP, o Grace foi projetado especificamente para IA e HPC em escala gigante. A Nvidia agora pode ser descrita como uma empresa de três chips. ”

Embora se espere que a grande maioria dos data centers seja servida por CPUs existentes, Grace se destina a servir a um segmento de nicho da computação.

Huang revelou que o Centro Nacional de Supercomputação da Suíça (CSCS) construirá um supercomputador, apelidado de Alps, que será alimentado por GPUs Grace e da Nvidia de próxima geração.

O Alps será construído pela Hewlett Packard Enterprise usando a nova linha de produtos de supercomputador HPE Cray EX, bem como a plataforma de supercomputação Nvidia HGX, e incluirá GPUs Nvidia, bem como CPU Grace.

Os usuários do CSCS poderão usar o Alps para realizar uma ampla gama de pesquisas científicas emergentes, desde a análise de artigos científicos até a geração de novas moléculas para a descoberta de medicamentos.

O Laboratório Nacional de Los Alamos, do Departamento de Energia dos Estados Unidos, também colocará um supercomputador equipado com Grace online em 2023, anunciou a Nvidia.

Bluefield-3 DPU

Acelerando ainda mais a infraestrutura sobre a qual os centros de dados em hiperescala, estações de trabalho e supercomputadores são construídos, Huang apresentou o novo BlueField-3 DPU.

De acordo com Huang, “Este DPU permitirá que todas as empresas forneçam aplicativos em qualquer escala com desempenho líder do setor e segurança de data center. Ele foi otimizado para ambientes multi-tenant e nativos da nuvem, oferecendo serviços de rede, armazenamento e gerenciamento acelerados por hardware definidos por software em uma escala de data center. ”

Enquanto o BlueField-2 descarregava o equivalente a 30 núcleos de CPU, com o Bluefield-3 seriam necessários 300 núcleos de CPU para proteger, descarregar e acelerar o tráfego de rede a 400 Gbps, pois fornece um salto de 10x no desempenho, explicou Huang.

Tanto Grace quanto BlueField formam partes essenciais de um roteiro de data center que agora consiste em CPUs, GPUs e DPUs, acrescentou Huang.

“Cada arquitetura de chip tem um ritmo de dois anos com provavelmente um retrocesso entre eles. Um ano se concentrará em plataformas x86, o próximo em plataformas Arm ”, disse Huang, que acrescentou:“ Todos os anos, você verá novos produtos interessantes de nós. ”

Expandindo o braço para a nuvem

Falando antes da notícia de que o governo do Reino Unido estava instruindo a autoridade de concorrência do Reino Unido, a CMA, para investigar a proposta de aquisição da Arm, Huang falou longamente sobre a Arm e disse que ela se tornou a CPU mais popular do mundo por um 'bom motivo' , sugerindo que não era apenas "supereficiente em termos de energia", mas que seu "modelo de licenciamento aberto inspirou um mundo de inovadores".

Se esse modelo permanecer em vigor caso a aquisição prossiga, ainda é um ponto discutível, mas Huang usou sua palestra para anunciar novas parcerias da Arm cobrindo Amazon Web Services em computação em nuvem, Ampere Computing em computação científica e em nuvem, Marvel em servidores de borda hiperconvergente e MediaTek que criará um Chrome OS e Linux PC SDK e sistema de referência.

“O ecossistema global de empresas de tecnologia da Arm levará produtos baseados na Arm para novos mercados como nuvem, supercomputação, PC e sistemas autônomos. Com as novas parcerias anunciadas, estamos dando passos importantes para expandir o ecossistema da Arm para além do móvel e integrado ”, disse Huang.

A Nvidia e a AWS estão trabalhando juntas para implantar instâncias baseadas em Arm aceleradas por GPU na nuvem. As novas instâncias do Amazon EC2 reunirão processadores AWS Graviton2 e GPUs Nvidia para fornecer uma gama de benefícios, incluindo custo mais baixo, suporte para experiências mais ricas de streaming de jogos e maior desempenho para cargas de trabalho baseadas em Arm.

As instâncias permitirão aos desenvolvedores de jogos executar jogos Android nativamente no AWS, acelerar a renderização e codificação com GPUs Nvida e transmitir jogos para dispositivos móveis sem a necessidade de executar software de emulação.

O Arm HPC Developer Kit da Nvidia foi desenvolvido para oferecer suporte à computação científica em meio à crescente necessidade de supercomputadores e data centers com eficiência energética.

O kit inclui uma CPU Ampere Altra, com 80 núcleos Arm Neoverse rodando até 3.3 GHz; GPUs Nvidia A100 duplas, cada uma fornecendo 312 teraflops de desempenho de aprendizado profundo FP16, bem como dois DPUs BlueField-2, que se destinam a acelerar a rede, o armazenamento e a segurança.

Desenvolvedores e parceiros ISVs podem usar o devkit para migrar e validar seu software e conduzir análises de desempenho.

Os centros de computação que o implantam incluem o Oak Ridge National Laboratory, o Los Alamos National Laboratory e a Stony Brook University nos Estados Unidos; o Centro Nacional de Computação de Alto Desempenho, em Taiwan; e o Instituto Coreano de Ciência e Tecnologia.

Omniverse da Nvidia

Huang também revelou o Nvidia Omniverse. Uma plataforma nativa da nuvem, escalável para várias GPUs e fisicamente precisa, é capaz de recriar mundos virtuais 3D que aproveitam o rastreamento de caminho em tempo real RTX e DLSS, simula materiais com Nvidia MDL, simula física com Nvidia PhysX e integra totalmente a Nvidia AI.

De acordo com Huang the, “Omniverse foi feito para criar mundos 3D virtuais compartilhados. Uns não muito diferentes do metaverso de ficção científica descrito por Neal Stephenson em seu romance 'Snow Crash' do início dos anos 1990 ”

Omniverse estará disponível para licenciamento empresarial e atualmente está com parceiros beta abertos, como Foster and Partners em arquitetura, ILM em entretenimento, Activision em jogos e o gigante de publicidade WPP.

Demonstrando as possibilidades do Omniverse Huang, junto com Milan Nedeljković, membro do Conselho de Administração da BMW, mostrou como um modelo digital fotorrealista em tempo real - um "gêmeo digital" de uma das fábricas altamente automatizadas da BMW - poderia ser usado para acelerar a fabricação moderna.

“Essas inovações reduzirão os tempos de planejamento, melhorarão a flexibilidade e a precisão e produzirão um planejamento 30% mais eficiente”, disse Nedeljković.

Outros anúncios incluíram a revelação do Megatron, uma estrutura para treinamento de Transformers, levando a avanços no processamento de linguagem natural - transformadores geram resumos de documentos, frases completas em e-mail, questionários de notas, geram comentários esportivos ao vivo e até códigos - bem como novos modelos para Clara Discovery, bibliotecas de aceleração da Nvidia para descoberta computacional de drogas.

Outro anúncio dizia respeito à Nvidia Morpheus - uma plataforma de segurança de data center para inspeção de todos os pacotes em tempo real construída em Nvidia AI, BlueField, software de telemetria de rede Net-Q e EGX.

Para acelerar a IA de conversação, Huang também anunciou a disponibilidade da Nvidia Jarvis - uma IA de aprendizado profundo de última geração para reconhecimento de fala, compreensão de linguagem, traduções e fala expressiva.

Hoje, a Nvidia está oferecendo GPUs, CPUs e DPUs e continua a investir pesadamente em IA e no Omniverse da empresa

Ao concluir sua palestra, Huang, dirigindo-se ao público online, disse que a Nvidia era “o instrumento para o trabalho de sua vida” e na extensão e amplitude dos anúncios deixou clara a escala da ambição da empresa e sua 'ambição singular'.