Knowles lanza Raspberry Pi Dev Kit para permitir la integración de voz

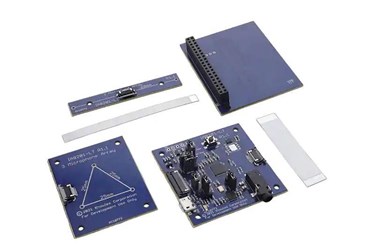

Knowles pone a disposición el kit de desarrollo AISonic IA8201 Raspberry Pi que brinda capacidades de escucha de voz, procesamiento de borde de audio y aprendizaje automático (ML) a dispositivos y sistemas en una variedad de industrias diferentes.

Los diseñadores e ingenieros de productos ahora tendrán acceso a una única herramienta para optimizar el diseño, el desarrollo y las pruebas de la tecnología que ayudarán a ampliar la integración de voz y audio en sus respectivas industrias.

“Knowles diseñó este kit para que sea la forma más sencilla y rápida para que los diseñadores de productos creen prototipos de nuevas innovaciones para abordar casos de uso emergentes, incluida la voz contextualizada, la escucha de ML y el procesamiento de audio en tiempo real, que requieren herramientas de desarrollo flexibles para acelerar el proceso de diseño, minimizar los costos de desarrollo y aprovechar los nuevos avances tecnológicos ”, dijo Vikram Shrivastava, director senior de marketing de IoT en Knowles. "Al seleccionar Raspberry Pi como el host del sistema, estamos abriendo la capacidad de agregar voz y ML a la comunidad más grande de desarrolladores de sistemas que prefieren un entorno Linux o Android".

El kit está construido alrededor del procesador de borde de audio Knowles AISonic IA8201 OpenDSP, para una potencia ultrabaja y un alto rendimiento. El procesador de borde de audio combina dos núcleos DSP centrados en audio basados en Tensilica; uno para aplicaciones de computación de alta potencia y AI / ML, y el otro para procesamiento de entradas de sensor siempre activo y de muy baja potencia.

El IA8201 tiene 1 MB de RAM en el chip que permite el procesamiento de gran ancho de banda de casos de uso de ML avanzados, siempre activos y conscientes del contexto y memoria para múltiples algoritmos para una experiencia de usuario óptima.

Usando la plataforma DSP abierta, el kit incluye una biblioteca de algoritmos de audio integrados y bibliotecas AI / ML. Las aplicaciones de audio de Farfield se pueden crear utilizando la activación de voz de potencia ultrabaja disponible, formación de haces, palabras clave personalizadas, eliminación de ruido de fondo, de los socios del algoritmo de Knowles del ecosistema de voz inteligente como Amazon Alexa, Sensory, Retune y Alango que admiten una amplia gama de personalización de voz y audio.

El kit también incluye TensorFlow Lite-Micro SDK para la creación rápida de prototipos y el desarrollo de productos para aplicaciones de IA / ML. Esto permite portar modelos desarrollados en marcos de Tensor Flow en la nube más grandes a una plataforma integrada, generalmente con cómputo limitado y menor consumo de energía en el borde, por ejemplo, motores de inferencia de IA para verticales como industrial y comercial.

Con opciones para dos o tres micrófonos Knowles Everest preintegrados según las necesidades del producto, el kit incluye dos tarjetas de matriz de micrófonos para ayudar a seleccionar las configuraciones de algoritmo adecuadas para la aplicación final.

Según Knowles, al ofrecer arreglos de micrófonos integrados que admiten las capacidades de audio y voz en el DSP IA8201, los OEM tendrán acceso a una solución de desarrollo todo en uno de alta calidad y alto rendimiento de un solo proveedor.

El soporte para desarrolladores está disponible a través del portal de soluciones Knowles para herramientas de configuración, firmware y algoritmos que vienen de serie con el kit, lo que permite la creación de prototipos, el diseño y la depuración completos.