Knowles lanceert Raspberry Pi Dev Kit om spraakintegratie mogelijk te maken

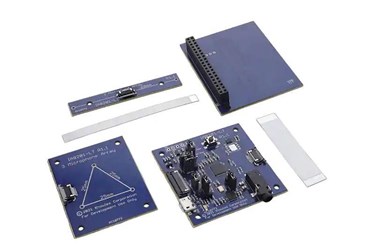

Knowles stelt de AISonic IA8201 Raspberry Pi Development Kit beschikbaar die spraak, audio edge processing en machine learning (ML) luistermogelijkheden biedt aan apparaten en systemen in een groot aantal verschillende industrieën.

Productontwerpers en ingenieurs hebben nu toegang tot één enkele tool om het ontwerp, de ontwikkeling en het testen te stroomlijnen technologie die zullen helpen de spraak- en audio-integratie in hun respectieve industrieën uit te breiden.

"Knowles heeft deze kit ontworpen om de eenvoudigste en snelste manier te zijn voor productontwerpers om prototypes te maken van nieuwe innovaties om opkomende use-cases aan te pakken, waaronder contextueel bewuste stem, ML-luisteren en realtime audioverwerking, waarvoor flexibele ontwikkelingstools nodig zijn om het ontwerpproces te versnellen, minimaliseer de ontwikkelingskosten en maak gebruik van nieuwe technologische ontwikkelingen”, zegt Vikram Shrivastava, senior director IoT Marketing bij Knowles. "Door Raspberry Pi als systeemhost te selecteren, openen we de mogelijkheid om spraak en ML toe te voegen aan de grootste gemeenschap van systeemontwikkelaars die de voorkeur geven aan een Linux- of Android-omgeving."

De kit is gebouwd rond de Knowles AISonic IA8201 Audio Edge Processor OpenDSP, voor ultralaag vermogen en hoge prestaties. De audio edge-processor combineert twee op Tensilica gebaseerde, op audio gerichte DSP-kernen; één voor high-power compute- en AI/ML-toepassingen, en de andere voor zeer energiezuinige, always-on verwerking van sensorinvoer.

De IA8201 heeft 1 MB RAM-geheugen op de chip, wat zorgt voor verwerking met hoge bandbreedte van geavanceerde, altijd ingeschakelde contextueel bewuste ML-gebruiksgevallen en geheugen voor meerdere algoritmen voor een optimale gebruikerservaring.

De kit maakt gebruik van het open DSP-platform en bevat een bibliotheek met ingebouwde audio-algoritmen en AI/ML-bibliotheken. Farfield-audiotoepassingen kunnen worden gebouwd met behulp van de beschikbare ultra-low power voice wake, beamforming, aangepaste trefwoorden, achtergrondruisverwijdering, van Knowles-algoritmepartners van het intelligente stemecosysteem zoals Amazon Alexa, Sensory, Retune en Alango die een breed scala aan spraak- en audioaanpassing.

De kit bevat ook TensorFlow Lite-Micro SDK voor snelle prototyping en productontwikkeling voor AI/ML-toepassingen. Dit maakt het mogelijk om modellen die in grotere cloud Tensor Flow-frameworks zijn ontwikkeld, over te zetten naar een ingebed platform, meestal met beperkte rekenkracht en een lager stroomverbruik aan de rand, bijvoorbeeld AI-inferentie-engines voor verticale markten zoals industrieel en commercieel.

Met opties voor twee of drie vooraf geïntegreerde Knowles Everest-microfoons op basis van de behoeften van het product, bevat de kit twee microfoonarraykaarten om de juiste algoritmeconfiguraties voor de eindtoepassing te helpen selecteren.

Volgens Knowles krijgen OEM's, door ingebouwde microfoonarrays aan te bieden die de audio- en spraakmogelijkheden op de IA8201 DSP ondersteunen, toegang tot een hoogwaardige, krachtige alles-in-één ontwikkelingsoplossing van één leverancier.

Ondersteuning voor ontwikkelaars is beschikbaar via de Knowles Solutions Portal voor configuratietools, firmware en algoritmen die standaard bij de kit worden geleverd, waardoor volledige prototyping, ontwerp en foutopsporing mogelijk is.