Knowles lança Raspberry Pi Dev Kit para permitir integração de voz

A Knowles está disponibilizando o kit de desenvolvimento AISonic IA8201 Raspberry Pi, trazendo recursos de escuta de voz, processamento de ponta de áudio e aprendizado de máquina (ML) para dispositivos e sistemas em uma variedade de setores diferentes.

Os designers e engenheiros de produtos agora terão acesso a uma única ferramenta para agilizar o projeto, o desenvolvimento e os testes de tecnologia que ajudarão a ampliar a integração de voz e áudio em seus respectivos setores.

“Knowles projetou este kit para ser a maneira mais simples e rápida para os designers de produtos criarem protótipos de inovações para lidar com casos de uso emergentes, incluindo voz contextualmente consciente, escuta de ML e processamento de áudio em tempo real, que exigem ferramentas de desenvolvimento flexíveis para acelerar o processo de design, minimizar os custos de desenvolvimento e alavancar novos avanços tecnológicos ”, disse Vikram Shrivastava, diretor sênior de IoT Marketing da Knowles. “Ao selecionar Raspberry Pi como o host do sistema, estamos abrindo a capacidade de adicionar voz e ML para a maior comunidade de desenvolvedores de sistema que preferem um ambiente Linux ou Android.”

O kit é construído em torno do processador Knowles AISonic IA8201 Audio Edge OpenDSP, para ultra-baixo consumo de energia e alto desempenho. O processador de ponta de áudio combina dois núcleos DSP centrados em áudio baseados em Tensilica; um para computação de alta potência e aplicativos de AI / ML e o outro para processamento sempre ativo e de muito baixo consumo de entradas de sensor.

O IA8201 tem 1 MB de RAM no chip que permite o processamento de alta largura de banda de casos de uso de ML com reconhecimento de contexto e memória para vários algoritmos para uma experiência de usuário ideal.

Usando a plataforma DSP aberta, o kit inclui uma biblioteca de algoritmos de áudio on-board e bibliotecas AI / ML. Os aplicativos de áudio Farfield podem ser construídos usando a ativação de voz de ultra-baixa potência, formação de feixes, palavras-chave personalizadas, eliminação de ruído de fundo, de parceiros de algoritmo da Knowles do ecossistema de voz inteligente, como Amazon Alexa, Sensory, Retune e Alango, suportando uma ampla gama de personalização de voz e áudio.

O kit também apresenta o TensorFlow Lite-Micro SDK para prototipagem rápida e desenvolvimento de produtos para aplicativos AI / ML. Isso permite portar modelos desenvolvidos em estruturas de Tensor Flow em nuvem maior para uma plataforma incorporada, geralmente com computação limitada e menor consumo de energia na borda, por exemplo, mecanismos de inferência de IA para verticais, como industrial e comercial.

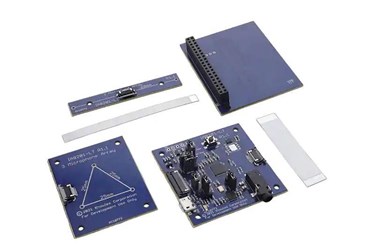

Com opções para dois ou três microfones Knowles Everest pré-integrados com base nas necessidades do produto, o kit inclui duas placas de matriz de microfone para ajudar a selecionar as configurações de algoritmo apropriadas para a aplicação final.

De acordo com Knowles, ao oferecer conjuntos de microfones integrados que suportam os recursos de áudio e voz no DSP IA8201, os OEMs terão acesso a uma solução de desenvolvimento multifuncional de alta qualidade e alto desempenho de um único fornecedor.

O suporte do desenvolvedor está disponível através do Portal de Soluções da Knowles para ferramentas de configuração, firmware e algoritmos que vêm como padrão com o kit, permitindo prototipagem completa, design e depuração.