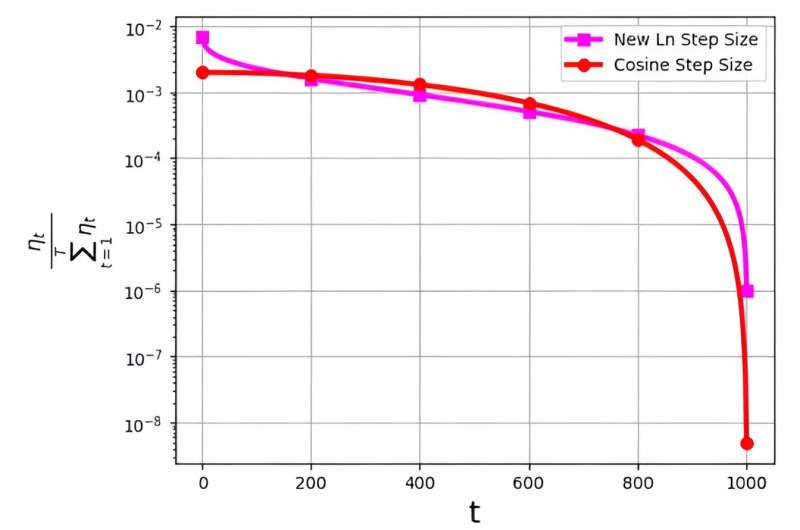

Saiz langkah, sering dirujuk sebagai kadar pembelajaran, memainkan peranan penting dalam mengoptimumkan kecekapan algoritma keturunan kecerunan stokastik (SGD). Sejak kebelakangan ini, strategi saiz berbilang langkah telah muncul untuk meningkatkan prestasi SGD. Walau bagaimanapun, cabaran penting yang dikaitkan dengan saiz langkah ini adalah berkaitan dengan taburan kebarangkalian mereka, dilambangkan sebagai ηt/ΣTt = 1ηt .

Taburan ini telah diperhatikan untuk mengelakkan pemberian nilai yang sangat kecil kepada lelaran akhir. Sebagai contoh, saiz langkah kosinus yang digunakan secara meluas, walaupun berkesan dalam amalan, menghadapi isu ini dengan memberikan nilai taburan kebarangkalian yang sangat rendah kepada lelaran terakhir.

Untuk menangani cabaran ini, pasukan penyelidik yang diketuai oleh M. Soheil Shamaee menerbitkan penyelidikan mereka dalam Sempadan Sains Komputer.

Pasukan ini memperkenalkan saiz langkah logaritma baharu untuk pendekatan SGD. Saiz langkah baharu ini telah terbukti berkesan terutamanya semasa lelaran akhir, di mana ia menikmati kebarangkalian pemilihan yang jauh lebih tinggi berbanding saiz langkah kosinus konvensional.

Akibatnya, kaedah saiz langkah baharu mengatasi prestasi kaedah saiz langkah kosinus dalam lelaran kesimpulan kritikal ini, mendapat manfaat daripada peningkatan kemungkinan mereka dipilih sebagai penyelesaian yang dipilih. Keputusan berangka yang diperoleh berfungsi sebagai bukti kecekapan saiz langkah yang baru dicadangkan, terutamanya pada set data FashionMinst, CIFAR10 dan CIFAR100.

Selain itu, saiz langkah logaritma baharu telah menunjukkan peningkatan yang luar biasa dalam ketepatan ujian, mencapai peningkatan 0.9% untuk set data CIFAR100 apabila digunakan dengan model rangkaian neural convolutional (CNN).