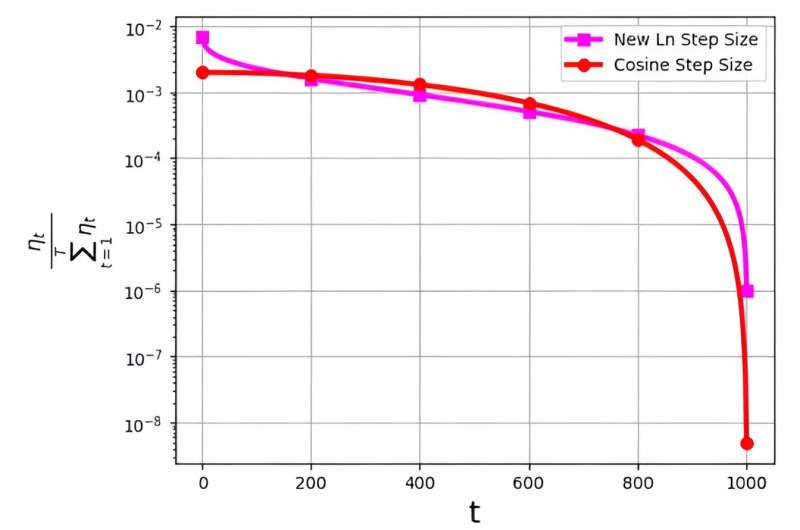

Kích thước bước, thường được gọi là tốc độ học, đóng vai trò then chốt trong việc tối ưu hóa hiệu quả của thuật toán giảm độ dốc ngẫu nhiên (SGD). Trong thời gian gần đây, các chiến lược quy mô nhiều bước đã xuất hiện để nâng cao hiệu suất SGD. Tuy nhiên, một thách thức đáng kể liên quan đến các kích thước bước này có liên quan đến phân bố xác suất của chúng, ký hiệu là ηt/ΣTt = 1ηt.

Sự phân bổ này đã được quan sát để tránh gán các giá trị quá nhỏ cho lần lặp cuối cùng. Ví dụ, kích thước bước cosin được sử dụng rộng rãi, mặc dù có hiệu quả trong thực tế nhưng lại gặp phải vấn đề này bằng cách gán các giá trị phân bố xác suất rất thấp cho các lần lặp cuối cùng.

Để giải quyết thách thức này, một nhóm nghiên cứu do M. Soheil Shamaee dẫn đầu đã công bố nghiên cứu của họ trên tạp chí Biên giới của khoa học máy tính.

Nhóm giới thiệu kích thước bước logarit mới cho phương pháp SGD. Kích thước bước mới này đã được chứng minh là đặc biệt hiệu quả trong các bước lặp cuối cùng, nơi nó có xác suất lựa chọn cao hơn đáng kể so với kích thước bước cosin thông thường.

Kết quả là, phương pháp kích thước bước mới vượt trội hơn hiệu suất của phương pháp kích thước bước cosin trong các bước lặp kết thúc quan trọng này, được hưởng lợi từ khả năng được chọn làm giải pháp được chọn tăng lên. Các kết quả bằng số thu được đóng vai trò là minh chứng cho tính hiệu quả của kích thước bước mới được đề xuất, đặc biệt là trên các bộ dữ liệu FashionMinst, CIFAR10 và CIFAR100.

Ngoài ra, kích thước bước logarit mới đã cho thấy những cải thiện đáng kể về độ chính xác của thử nghiệm, đạt mức tăng 0.9% cho tập dữ liệu CIFAR100 khi được sử dụng với mô hình mạng thần kinh tích chập (CNN).