Profesor Komunikasi ComArtSci Jingbo Meng ingin melihat seberapa efektif chatbot kecerdasan buatan (AI) dalam menyampaikan pesan yang mendukung. Jadi dia mengatur penelitian dan menggunakan platform pengembangan chatbot untuk mengujinya.

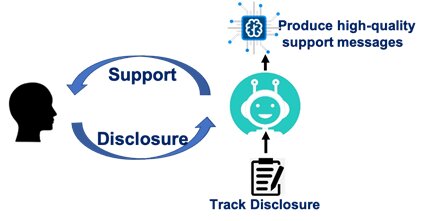

“Chatbots telah banyak diterapkan dalam layanan pelanggan melalui komunikasi berbasis teks atau suara,” katanya. “Adalah perpanjangan alami untuk memikirkan bagaimana chatbot AI dapat berperan dalam memberikan empati setelah mendengarkan cerita dan kekhawatiran seseorang.”

Mengobrol

Pada awal 2019, Meng mulai menilai efektivitas chatbot empatik dengan membandingkannya dengan obrolan manusia. Dia telah mengikuti pertumbuhan aplikasi kesehatan dan kebugaran digital, dan melihat pertumbuhan fenomenal yang terkait dengan kesehatan mental. Kolaborasi sebelumnya dengan rekan teknik MSU berfokus pada sistem seluler yang dapat dipakai untuk merasakan, melacak, dan menanyakan pengguna tentang penanda perilaku stres dan depresi. Kolaborasi tersebut menginspirasinya untuk menggunakan chatbot yang memulai percakapan dengan pengguna ketika penanda perilaku diidentifikasi.

“Kami merasakan bahwa beberapa komunikasi chatbot mungkin berfungsi, yang lain mungkin tidak,” kata Meng. “Saya ingin melakukan lebih banyak penelitian untuk memahami mengapa sehingga kami dapat mengembangkan pesan yang lebih efektif untuk digunakan dalam aplikasi kesehatan mental.”

Meng merekrut 278 mahasiswa MSU untuk studinya, dan meminta mereka untuk mengidentifikasi penyebab stres utama yang mereka alami dalam sebulan terakhir. Peserta kemudian terhubung melalui Facebook Messenger dengan mitra obrolan empatik. Satu kelompok diberitahu bahwa mereka akan berbicara dengan chatbot, yang lain mengerti bahwa mereka akan berbicara dengan manusia. Kerutan? Meng mengaturnya sehingga hanya chatbots yang mengirimkan pertanyaan dan pesan, memungkinkannya untuk mengukur apakah peserta bereaksi secara berbeda ketika mereka mengira mitra obrolan mereka adalah manusia.

Meng juga memvariasikan tingkat keterbukaan diri timbal balik yang akan dialami peserta selama sesi 20 menit mereka. Beberapa chatbots berbagi pengalaman mereka sendiri sebagai cara untuk membangkitkan empati. Chatbots lain hanya menguraikan masalah pribadi mereka sendiri dengan mengorbankan tidak memvalidasi peserta. ”

Dengan pengecualian skenario pengungkapan diri timbal balik yang berbeda, konten dan alur percakapan ditulis dengan persis sama untuk chatbots dan untuk mitra obrolan manusia yang dirasakan. Chatbots meminta peserta untuk mengidentifikasi stresor. Mereka bertanya bagaimana perasaan peserta. Mereka menyelidiki mengapa peserta berpikir stres membuat mereka merasakan cara tertentu. Kemudian chatbots berbagi pengalaman mereka sendiri.

"Mereka diprogram untuk memvalidasi dan membantu peserta melewati situasi stres," katanya. “Tujuan kami adalah untuk melihat seberapa efektif pesan itu.”

Merawat

Meng menemukan bahwa apakah berbicara dengan chatbot atau manusia, peserta harus merasa pasangannya mendukung atau peduli. Jika kondisi itu terpenuhi, percakapan berhasil mengurangi stres.

Studinya juga mengungkapkan bahwa terlepas dari pesannya, peserta merasa manusia lebih peduli dan mendukung daripada chatbot.

Skenarionya tentang pengungkapan diri timbal balik menceritakan kisah lain. Mitra manusia yang membuka diri—terlepas dari apakah niat mereka untuk berempati atau hanya untuk menguraikan masalah mereka sendiri—berkontribusi pada pengurangan stres. Tapi chatbots yang mengungkapkan diri tanpa menawarkan dukungan emosional tidak banyak mengurangi stres peserta—bahkan lebih sedikit daripada chatbots yang tidak mengatakan apa-apa.

"Manusia lebih bisa diterima," kata Meng. “Ketika kita berbicara dengan manusia lain, bahkan ketika mereka tidak memvalidasi emosi kita, kita dapat berhubungan secara lebih alami. Chatbots, bagaimanapun, harus lebih eksplisit dan mengirim pesan berkualitas lebih tinggi. Jika tidak, pengungkapan diri dapat mengganggu dan tidak menyenangkan.”

Mengamati sumbernya

Meng melakukan dan menganalisis penelitian dengan Yue (Nancy) Dai, alumnus program doktor Komunikasi MSU tahun 2018 dan profesor di City University of Hong Kong. Temuan mereka dipublikasikan di Jurnal Komunikasi Mediasi Komputer.

Meng mengatakan penelitian ini menggarisbawahi bahwa chatbots yang digunakan dalam aplikasi kesehatan mental bekerja paling baik ketika dianggap sebagai sumber yang benar-benar peduli. Dia berencana untuk menindaklanjuti penelitian dengan penelitian tambahan yang meneliti bagaimana pesan dapat dirancang untuk meningkatkan faktor kepedulian.

Aplikasi kesehatan mental, katanya, tidak akan hilang, dan faktanya, semakin banyak digunakan dan tersedia. Sementara sebagian besar orang memiliki akses ke ponsel, banyak yang tidak memiliki akses siap ke terapis atau asuransi kesehatan. Aplikasi, katanya, dapat membantu individu mengelola situasi tertentu, dan dapat memberikan tolok ukur untuk perawatan suportif tambahan.

“Sama sekali tidak akan ada aplikasi dan chatbot yang menggantikan manusia,” katanya. “Kami percaya bahwa model hibrida dari AI chatbots dan terapis manusia akan sangat menjanjikan.”