ComArtSci のコミュニケーション准教授 Jingbo Meng は、人工知能 (AI) チャットボットが支援メッセージを配信する際にどれほど効果的であるかを確認したいと考えていました。 そこで彼女は研究を開始し、チャットボット開発プラットフォームを使用してテストしました。

「チャットボットは、テキストまたは音声ベースのコミュニケーションを通じて顧客サービスに広く適用されています」と彼女は言いました。 「誰かの話や懸念を聞いた後、共感を提供する上で AI チャットボットがどのような役割を果たすことができるかを考えるのは自然な延長です。」

おしゃべりする

2019 年初頭、Meng 氏は共感チャットボットを人間のチャットと比較することで、その有効性を評価し始めました。 彼女はデジタル ヘルスケアとウェルネス アプリの成長を追跡しており、メンタルヘルス関連アプリの驚異的な成長を目にしていました。 MSU のエンジニアリング部門の同僚とのこれまでのコラボレーションでは、ユーザーのストレスやうつ病の行動マーカーを感知、追跡、クエリするためのウェアラブル モバイル システムに焦点を当てていました。 このコラボレーションにより、行動マーカーが特定されたときにユーザーとの会話を開始するチャットボットを使用するようになりました。

「一部のチャットボット通信は機能する可能性があり、その他の通信は機能しない可能性があると感じました」と孟氏は言います。 「メンタルヘルス アプリ内で使用するより効果的なメッセージを開発できるよう、その理由を理解するためにさらに調査を行いたいと思いました。」

孟氏は研究のためにMSUの学部生278人を募集し、過去XNUMXカ月間に経験した主なストレス要因を特定するよう求めた。 その後、参加者は Facebook メッセンジャーを通じて共感的なチャット パートナーとつながりました。 あるグループはチャットボットと話すことになると説明され、別のグループは人間と話すことになると理解していました。 しわ? Meng 氏は、チャットボットのみがクエリとメッセージを配信するように設定し、参加者がチャットの相手を人間だと思ったときに反応が異なるかどうかを測定できるようにしました。

孟氏はまた、参加者が 20 分間のセッション中に体験する相互自己開示のレベルも変化させました。 一部のチャットボットは共感を呼び起こす方法として自分の経験を共有しました。 他のチャットボットは、参加者を検証しないという犠牲を払って、単に自分たちの個人的な問題について説明するだけでした。」

さまざまな相互自己開示シナリオを除いて、会話の内容と流れは、チャットボットと認識される人間のチャット パートナーに対してまったく同じようにスクリプト化されました。 チャットボットは参加者にストレス要因を特定するよう求めました。 彼らは参加者がどう感じたかを尋ねました。 彼らは、参加者がストレス要因によって特定の感情を引き起こされると考えた理由を調査しました。 次に、チャットボットが自分の経験を共有しました。

「それらは、参加者がストレスの多い状況を乗り越えられるかどうかを検証し、支援するようにプログラムされています」と彼女は言いました。 「私たちの目標は、メッセージングがどれほど効果的であるかを確認することでした。」

世話をして

Meng 氏は、チャットボットと話している場合でも人間と話している場合でも、参加者はパートナーが協力的または思いやりがあると感じなければならないことを発見しました。 その条件が満たされれば、会話はストレスを軽減することに成功します。

彼女の研究では、メッセージに関係なく、参加者は人間の方がチャットボットよりも思いやりがあり、協力的であると感じていることも明らかになりました。

相互的な自己開示に関する彼女のシナリオは、別の物語を語っていました。 自己開示をした人間のパートナーは、その意図が共感することであるか、単に自分の問題について詳しく説明することであるかに関係なく、ストレスの軽減に貢献しました。 しかし、感情的なサポートを提供せずに自己開示をするチャットボットは、参加者のストレスを軽減する効果がほとんどなく、まったく何も言わないチャットボットよりもさらに効果がありませんでした。

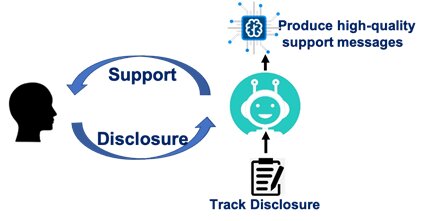

「人間は単純に共感しやすいのです」と孟氏は言う。 「他の人間と話すとき、たとえ彼らが私たちの感情を認めてくれなかったとしても、私たちはより自然に共感することができます。 ただし、チャットボットはより明示的で、高品質のメッセージを送信する必要があります。 そうしないと、自己開示が煩わしく、不快なものになる可能性があります。」

根源を認識する

孟氏は、MSU のコミュニケーション博士課程の 2018 年度卒業生で香港城市大学教授の Yue (Nancy) Dai 氏とともに研究を実施し、分析しました。 彼らの発見は、 コンピュータ媒介コミュニケーションのジャーナル。

孟氏は、この研究は、メンタルヘルスアプリで使用されるチャットボットが真に思いやりのある情報源として認識されている場合に最も効果的に機能することを強調していると述べた。 彼女は、思いやりの要素を高めるためにメッセージングをどのように設計できるかを調査する追加の研究でこの研究をフォローアップする予定です。

同氏によると、メンタルヘルスアプリは消えることはなく、実際、使用量と可用性は増加しているという。 大多数の人は携帯電話にアクセスできますが、多くの人はセラピストや健康保険にすぐにアクセスできません。 同氏によると、アプリは個人が特定の状況を管理するのに役立ち、追加の支持療法のベンチマークを提供できるという。

「これらのアプリやチャットボットが人間に取って代わることは決してありません」と彼女は言う。 「私たちは、ハイブリッドモデルは、 AI チャットボットと人間のセラピストは非常に有望です。」