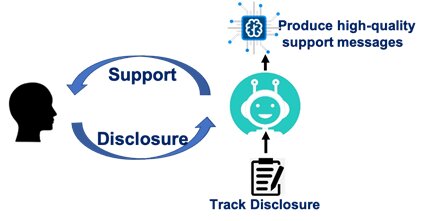

Phó Giáo sư Truyền thông của ComArtSci Jingbo Meng muốn xem các chatbot trí tuệ nhân tạo (AI) có thể mang lại hiệu quả như thế nào trong việc đưa ra các thông điệp hỗ trợ. Vì vậy, cô đã thiết lập nghiên cứu và sử dụng nền tảng phát triển chatbot để thử nghiệm nó.

Bà nói: “Chatbots đã được ứng dụng rộng rãi trong dịch vụ khách hàng thông qua giao tiếp bằng văn bản hoặc giọng nói. “Đó là một phần mở rộng tự nhiên để suy nghĩ về cách các chatbot AI có thể đóng một vai trò nào đó trong việc cung cấp sự đồng cảm sau khi lắng nghe những câu chuyện và mối quan tâm của ai đó”.

Trò chuyện nó lên

Vào đầu năm 2019, Meng bắt đầu đánh giá hiệu quả của chatbot đồng cảm bằng cách so sánh chúng với trò chuyện của con người. Cô đã theo dõi sự phát triển của các ứng dụng chăm sóc sức khỏe và chăm sóc sức khỏe kỹ thuật số, đồng thời nhận thấy sự phát triển phi thường của những ứng dụng liên quan đến sức khỏe tâm thần. Sự hợp tác trước đây của cô với các đồng nghiệp kỹ thuật MSU tập trung vào hệ thống di động có thể đeo để cảm nhận, theo dõi và truy vấn người dùng về các dấu hiệu hành vi của căng thẳng và trầm cảm. Sự hợp tác đã truyền cảm hứng cho cô ấy sử dụng chatbot để bắt đầu cuộc trò chuyện với người dùng khi các dấu hiệu hành vi được xác định.

“Chúng tôi nhận thấy rằng một số giao tiếp chatbot có thể hoạt động, những người khác có thể không,” Meng nói. “Tôi muốn nghiên cứu thêm để hiểu tại sao chúng tôi có thể phát triển các thông điệp hiệu quả hơn để sử dụng trong các ứng dụng sức khỏe tâm thần”.

Meng đã tuyển dụng 278 sinh viên chưa tốt nghiệp MSU cho nghiên cứu của mình và yêu cầu họ xác định các yếu tố gây căng thẳng chính mà họ đã trải qua trong tháng qua. Những người tham gia sau đó được kết nối thông qua Facebook Messenger với một đối tác trò chuyện đồng cảm. Một nhóm được cho biết họ sẽ nói chuyện với một chatbot, nhóm khác hiểu rằng họ sẽ nói chuyện với một con người. Các nếp nhăn? Meng đã thiết lập nó để chỉ chatbots gửi các truy vấn và tin nhắn, cho phép cô ấy đo lường xem những người tham gia có phản ứng khác khi họ nghĩ rằng đối tác trò chuyện của họ là con người hay không.

Meng cũng thay đổi mức độ mà những người tham gia tự tiết lộ có đi có lại sẽ trải qua trong các phiên họp kéo dài 20 phút của họ. Một số chatbot đã chia sẻ kinh nghiệm của riêng họ như một cách để khơi gợi sự đồng cảm. Các chatbot khác chỉ đơn giản giải thích các vấn đề cá nhân của riêng họ với chi phí là không xác thực những người tham gia. "

Ngoại trừ các kịch bản tự tiết lộ có đi có lại khác nhau, nội dung và luồng cuộc trò chuyện được viết kịch bản giống hệt nhau cho các chatbot và cho các đối tác trò chuyện của con người. Chatbots yêu cầu những người tham gia xác định các yếu tố gây căng thẳng. Họ hỏi những người tham gia cảm thấy như thế nào. Họ thăm dò lý do tại sao những người tham gia nghĩ rằng những tác nhân gây căng thẳng khiến họ cảm thấy theo những cách nhất định. Sau đó, các chatbot chia sẻ kinh nghiệm của riêng họ.

Cô nói: “Chúng được lập trình để xác nhận và giúp những người tham gia vượt qua những tình huống căng thẳng. "Mục tiêu của chúng tôi là xem thông điệp có thể hiệu quả như thế nào."

Chăm sóc

Meng phát hiện ra rằng dù nói chuyện với chatbot hay con người, một người tham gia phải cảm thấy đối tác đang hỗ trợ hoặc quan tâm. Nếu điều kiện đó được đáp ứng, cuộc trò chuyện đã thành công trong việc giảm căng thẳng.

Nghiên cứu của cô cũng tiết lộ rằng bất kể thông điệp nào, những người tham gia đều cảm thấy con người quan tâm và hỗ trợ nhiều hơn một chatbot.

Kịch bản của cô ấy về sự tự bộc lộ qua lại đã kể một câu chuyện khác. Các đối tác của con người tự tiết lộ - bất kể mục đích của họ là để được đồng cảm hay chỉ để giải thích các vấn đề của riêng họ - đã góp phần làm giảm căng thẳng. Nhưng những chatbot tự tiết lộ mà không cung cấp hỗ trợ tinh thần đã không làm giảm được căng thẳng của người tham gia — thậm chí còn ít hơn những chatbot không nói gì cả.

“Con người đơn giản là dễ gần gũi hơn,” Meng nói. “Khi chúng tôi nói chuyện với một người khác, ngay cả khi họ không xác thực được cảm xúc của chúng tôi, chúng tôi có thể liên hệ một cách tự nhiên hơn. Chatbots, tuy nhiên, phải rõ ràng hơn và gửi tin nhắn chất lượng cao hơn. Nếu không, việc tiết lộ bản thân có thể gây khó chịu và mất hứng thú. "

Nhận thức nguồn

Meng đã tiến hành và phân tích nghiên cứu với Yue (Nancy) Dai, cựu sinh viên năm 2018 của chương trình tiến sĩ Truyền thông của MSU và là giáo sư tại Đại học Thành phố Hồng Kông. Phát hiện của họ đã được công bố trên Tạp chí Truyền thông qua trung gian máy tính.

Meng cho biết nghiên cứu nhấn mạnh rằng chatbot được sử dụng trong các ứng dụng sức khỏe tâm thần hoạt động tốt nhất khi được coi là một nguồn thực sự quan tâm. Cô ấy có kế hoạch tiếp tục nghiên cứu với nghiên cứu bổ sung để xem xét cách nhắn tin có thể được thiết kế để tăng yếu tố quan tâm.

Cô ấy nói, các ứng dụng sức khỏe tâm thần sẽ không biến mất và trên thực tế, mức độ sử dụng và tính khả dụng ngày càng tăng. Trong khi phần lớn mọi người có thể sử dụng điện thoại di động, nhiều người không sẵn sàng tiếp cận với bác sĩ trị liệu hoặc bảo hiểm y tế. Cô ấy nói, ứng dụng có thể giúp các cá nhân quản lý các tình huống cụ thể và có thể cung cấp các điểm chuẩn để chăm sóc hỗ trợ bổ sung.

“Không có nghĩa là những ứng dụng và chatbot này sẽ thay thế con người,” cô nói. “Chúng tôi tin rằng mô hình kết hợp của AI chatbots và một nhà trị liệu con người sẽ rất hứa hẹn. ”